Google актуализира своите етични принципи относно изкуствения интелект (AI) във вторник, 4 февруари, като се отказа от ангажимента си да не използва технологията като оръжие или средство за наблюдение.

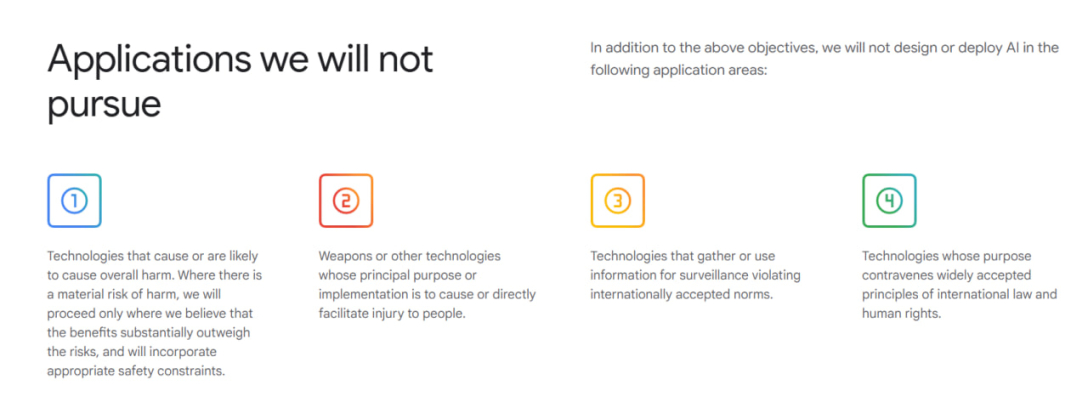

Преди това принципите на Google за AI включваха раздел, изброяващ области, в които компанията няма да разработва или внедрява AI. Според копие, публикувано на Wayback Machine, разделът се състои от четири точки:

- технологии, които причиняват или могат да причинят обща вреда;

- оръжия или други технологии, чиято основна цел или употреба е да причинят или пряко да допринесат за причиняване на вреди на хора;

- технологии, които събират или използват информация за целите на наблюдението в нарушение на общоприетите международни норми;

- технологии, чиято цел противоречи на общоприетите принципи на международното право и правата на човека.

От 5 февруари този раздел липсва от сайта, пише Washington Post. Говорител на Google отказа да отговори на въпросите на репортерите относно политиките на компанията относно оръжията и наблюдението, но се позова на доклад, публикуван във вторник от ръководителя на AI на компанията Демис Хасабис и нейния старши вицепрезидент по технологиите и обществото Джеймс Маника.

В доклада се казва, че Google актуализира своите принципи на AI, тъй като светът е изправен пред глобална конкуренция за лидерство в AI във все по-сложен геополитически пейзаж, който създаде нужда от компании, базирани в демократични страни и обслужващи правителствени и национални клиенти по сигурността.

„Ние вярваме, че демокрациите трябва да водят пътя в развитието на ИИ, ръководени от основните ценности на свобода, равенство и зачитане на човешките права. И ние вярваме, че компаниите, правителствата и организациите, които споделят тези ценности, трябва да работят заедно, за да създадат AI, който защитава хората, насърчава глобалния растеж и подкрепя националната сигурност“, казаха Хасабис и Маника.

Актуализираните принципи на AI на Google казват, че компанията ще използва човешки надзор и ще приема обратна връзка, за да гарантира, че нейната технология се използва в съответствие с „широко приетите принципи на международното право и човешките права“. Освен това компанията обещава да тества технологията си, за да „смекчи всички нежелани или вредни ефекти“.

Прочетете още

- 08:00 Баба Марта иде! – най-белият и най-червеният празник на българската душа

- 16:00 След смъртоносния хаос в Близкия изток: ще скочат ли цените на горивата?

- 14:11 Март преобръща играта: За 3 зодии има новини, които ще променят всичко

- 10:13 Младо момиче е в неизвестност от дни, виждали ли сте Ивилина? СНИМКА